前回のブログ記事に引き続き、今回はSamplesAR/Labについてお伝えします。

SamplesAR/LabはToF ARを使用したゲームなどのコンテンツが11~12種類含まれています。

SamplesBasicは利用できる機能をシンプルに確認できるアプリでしたが、SamplesAR/Labはより利用シーンに寄せたアプリとなっています。

SamplesARはGitHubにてソースコードのダウンロードを、ToF AR Labは各ストアでアプリをインストールをすることが可能です。

詳しくは以前記載したブログ、「ToF AR」スタートアップをご覧ください。

それぞれのシーンについてここから紹介していきます。

SimpleARFoundation

Unityから提供されているAR用のフレームワーク「ARFoundation」とTof ARの機能を同時利用することができる「ARFoundationConnector」の動作を確認できるシーンです。

ARFoundationConnectorの詳細についてはこちらをご覧ください。

機能としてはColor/Tofの表示やHandやMeshなどの機能が確認できるだけなのですが、内部ではARFoundationから取得したデータをTofARから出力して扱っているのでデータの管理を一本化できていることが利点です。

このシーンは開発者が特に参考になるシーンとなっています。

Hand機能を使用した例

Modeling機能によってスキャンされた部屋

Puppet/Hand Decoration/Rock Paper Scissors

Handのコンポーネントを使用したグラフィック表示とじゃんけんゲームのシーンです。

Puppetシーン(左の画像)は、左右の手を認識して赤と青のPuppetを手につけているかのように映ります。

Hand Decorationシーン(中央の画像)では、Decorationを手の甲に表示させることができます。

画像を撮影した時はLeafを選択しましたが、全4種類から選択することができます。

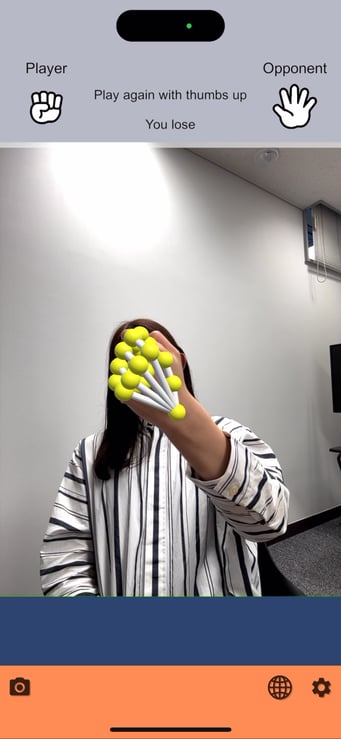

Rock Paper Scissorsシーン(右の画像)では、その名の通りじゃんけんができるシーンです。

Handコンポーネントには手のポーズを認識する機能が搭載されているので、グーチョキパーを認識することで、じゃんけんゲームができるようになっています。

Puppetシーン

Hand Decorationシーン

Rock Paper Scissorsシーン

Juggling

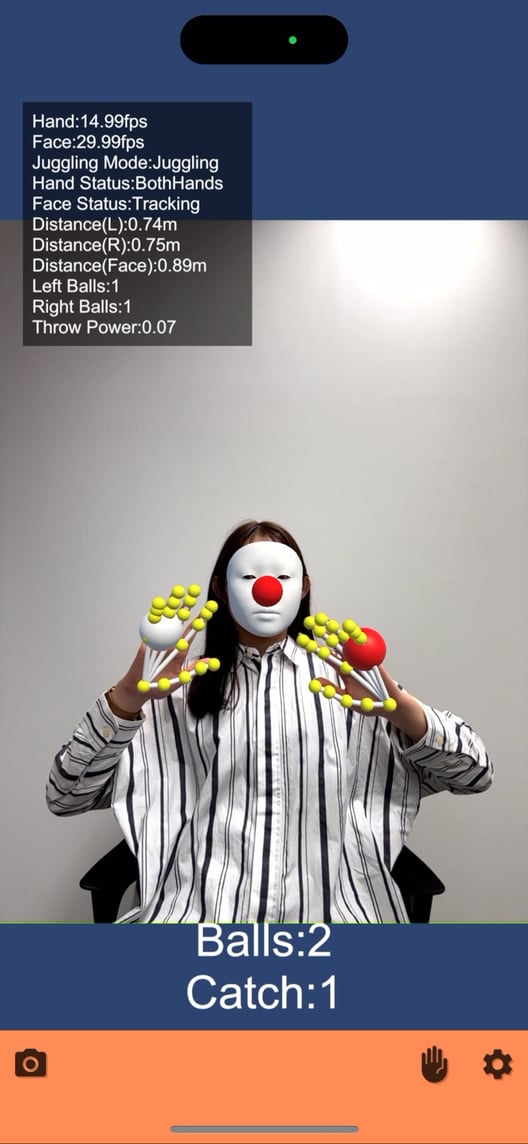

HandとFaceのコンポーネントを使用した、ジャグリングゲームのシーンです。

シーンを開いて、カメラと顔、手の距離を離すように指示が出ます。距離を取ると、ボールが上から落ちてきます。

ボールを右手から左手、左手から右手と投げてはキャッチをする動作を繰り返していくと、6回目で新たなボールが上から落ちてきます。(右の画像)

ボールは最大で6個まで追加されます。

ボールをキャッチする難易度を上げたい時は、右下の手のマークから「Catch Ball Range」の値を小さくするとボールキャッチの範囲が狭まるのでキャッチを難しく設定することができます。

Juggling開始

6回ボールキャッチ成功すると、

1個ボールが追加(最大6個)

BGChange

HandとSegmentationのコンポーネントを使用したバーチャル背景のシーンです。

Handコンポーネントのポーズ認識(サムズアップ)をトリガーとして、Segmentationコンポーネントで認識された背景部分にオーロラのアニメーションを再生します。

TextureRoom

Planeのコンポーネントを使用して、壁や地面などに文字や画像を表示できるシーンです。

モードは3種類あり、デフォルトでは左の画像のように漢字が並びます。(Texture Animationモード)

TextInputモードでは、右の画像のように好きな文字を入力して平面認識された部分に表示されます。

Stampモードは、好きな画像を選択すると平面認識された部分に貼ることができます。

画像は「Add Stamp Button」をタップしてカメラロールに保存している画像から選択可能です。

Plane認識によって平面に文字を表示

好きな文字を入力して平面に表示

BallPool/SandBox

Modelingのコンポーネントを使用したシーンです。

BallPool(右の画像)は、左下の「Ball」のチェックをONすると、中央からボールがあふれるように出てきます。

スキャンされた床や壁には当たり判定が付与されているので、ボールが認識された領域に溜まっていくことが確認できます。

ボールの数やスピードは左上の設定で変更することができます。

SandBoxRoomでは、まず部屋の全体をスキャンします。

スキャンが完了後ボタンを押すと、スキャンした形状に合わせて島や海などの3D空間が自動生成されます。

黄色い島は、実際には大きなデスクがあり、手前にある小さな黄色い島は実際には椅子の座面です。

島にいる人や牛をタップすると鳴いたりリアクションしてくれます。

BallPoolシーン

SandBoxRoomシーン

StepOn/Kirigami

DepthとSegmentationのコンポーネントを使用した、ビジュアルシーンです

どちらも共通して歩いた(足を踏み込んだ)ところや壁を触った部分に反応してエフェクトが表示されます。

StepOnでは草花が、Kirigamiからは蝶々が出現します。

蝶々は出現した場所の色や模様が切り抜かれた状態で表示されるので、アプリを動作させた場所によって見え方が変わります。

StepOnシーン

Kirigamiシーン

Avatar

Humanoidコンポーネントを使用した、Vtuberっぽい体験ができるシーンです。

Hand/Body/Face など様々なコンポーネントを組み合わせることで、キャラクターのモデルを自身の動きに連動して操作することができます。手の指、腕の動き、表情の切り替えなど様々な動きを確認することが可能です。

このシーンでは様々な応用設定が可能で右の画像ではギターを持つ設定をしてみました。

手の位置が固定されてるので、とても自然な形でアバターがギターを演奏しているように表示することができます。

他にもピアノを演奏するポーズにしたり、特定の手のポーズをした時に絵を描く設定などが可能です。

表情など顔のパーツを認識

ギターを持たせてみた

シーンの説明は以上です。

ぜひインストールしてお手元のスマホで体験してみてください。

特に、ToF ARは実際にVtuberに使用された実績があるので、AvatarシーンでVtuber気分を味わえる思います。

(※Avatarシーンは、ToF AR Labアプリをインストールした場合のみ使用可能です。)

次回はToF AR Serverアプリについてブログをアップする予定です。

実はあまり知られていない、ToF AR開発に便利なアプリです。次回もぜひ読みにきてくださいね。

システムフレンドはxRの技術を利用し、楽しい「体験」を実現するための開発を行っています。

ご相談や事例の紹介など弊社のエンジニアがフレンドリーに対応させていただきます。

お気軽にお問い合わせください。